DeepSeek系列模型完全使用手册|附安装教程

前言

DeepSeek系列模型在去年12月发布以来引起了不少关注,而推理模型R1的发布则进一步点燃了国内外用户的热情。鉴于仍有不少用户完全没有使用经验,而网上现有的信息可能比较零碎,反而会导致初学者更加困惑。因此本文整理了DeepSeek系列模型的基本说明和一些使用方法,此外还提供了一个第三方客户端的安装教程,用于让初学者也能用上国产最强大的推理模型。

本地环境使用

原始模型权重

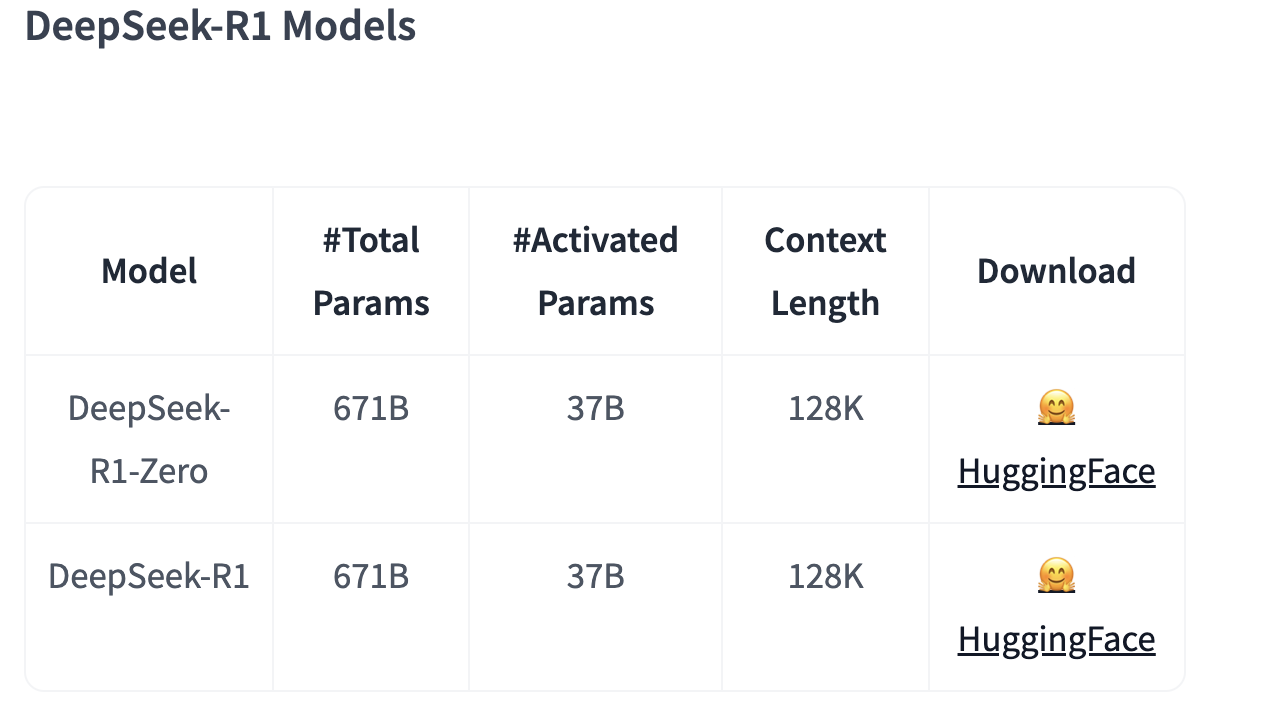

原始模型权重在HF上开源,可免费下载。R1模型大小有671B参数,使用默认的半精度加载,至少需要1300GB以上的显存,如果使用4-bit进行量化,理论上也需要300GB以上的显存。与V3类似,R1也不支持使用transformers库进行加载推理,建议使用vLLM进行推理部署。

本地部署R1模型的一种方案,使用了7台M4 Pro Mac Mini + 1台M4 Max MacBook Pro堆叠统一内存,4-bit量化后仍需要近500GB的显存。

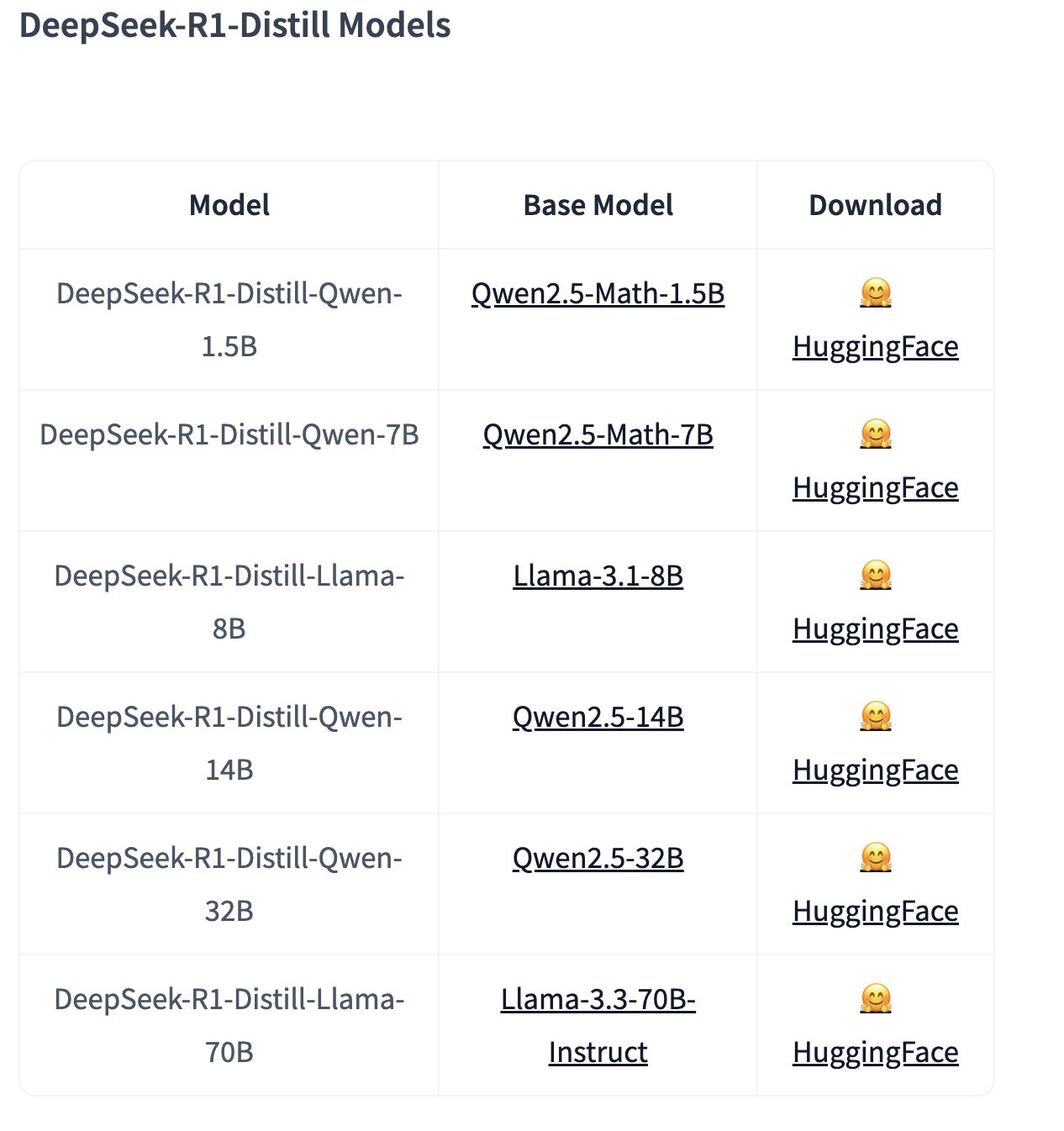

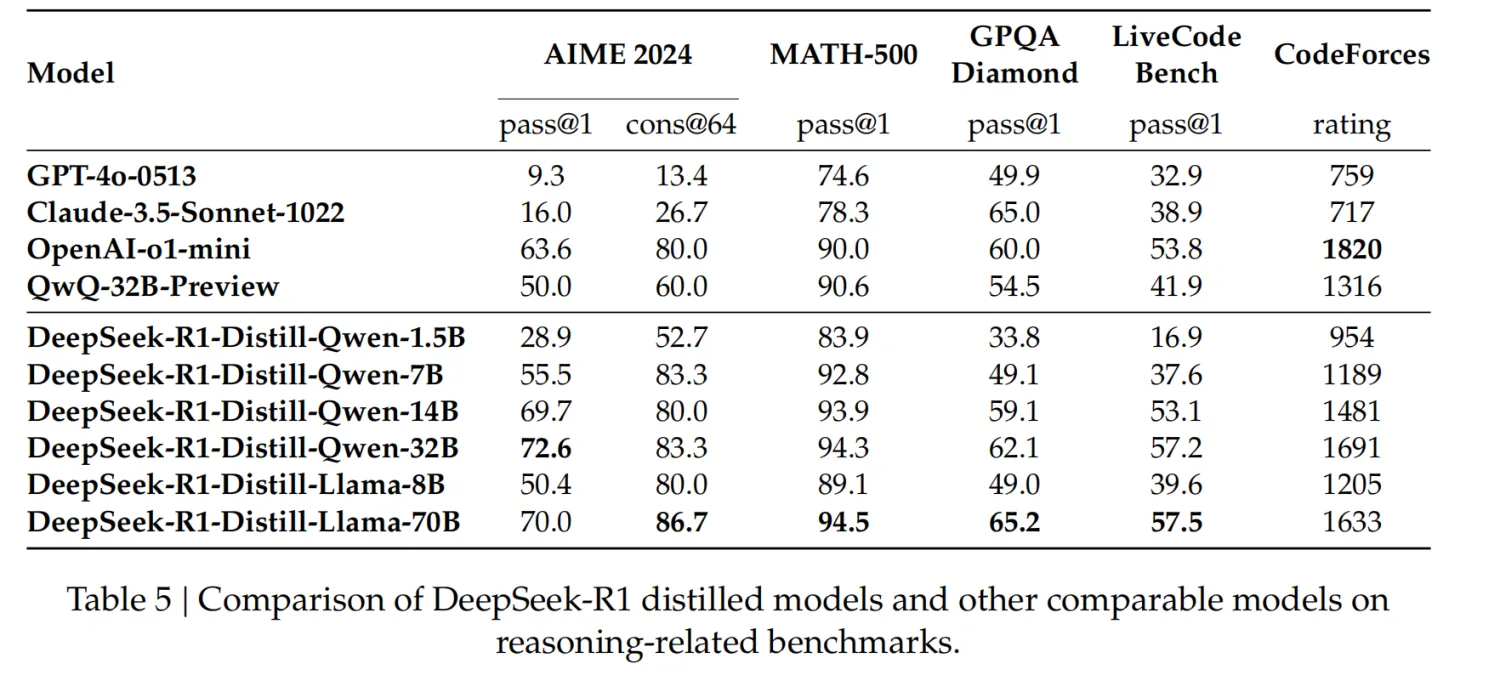

此外,DeepSeek团队使用Qwen2.5和Llama3.3蒸馏了6款模型,包含1.5B~70B在内共有6个尺寸。

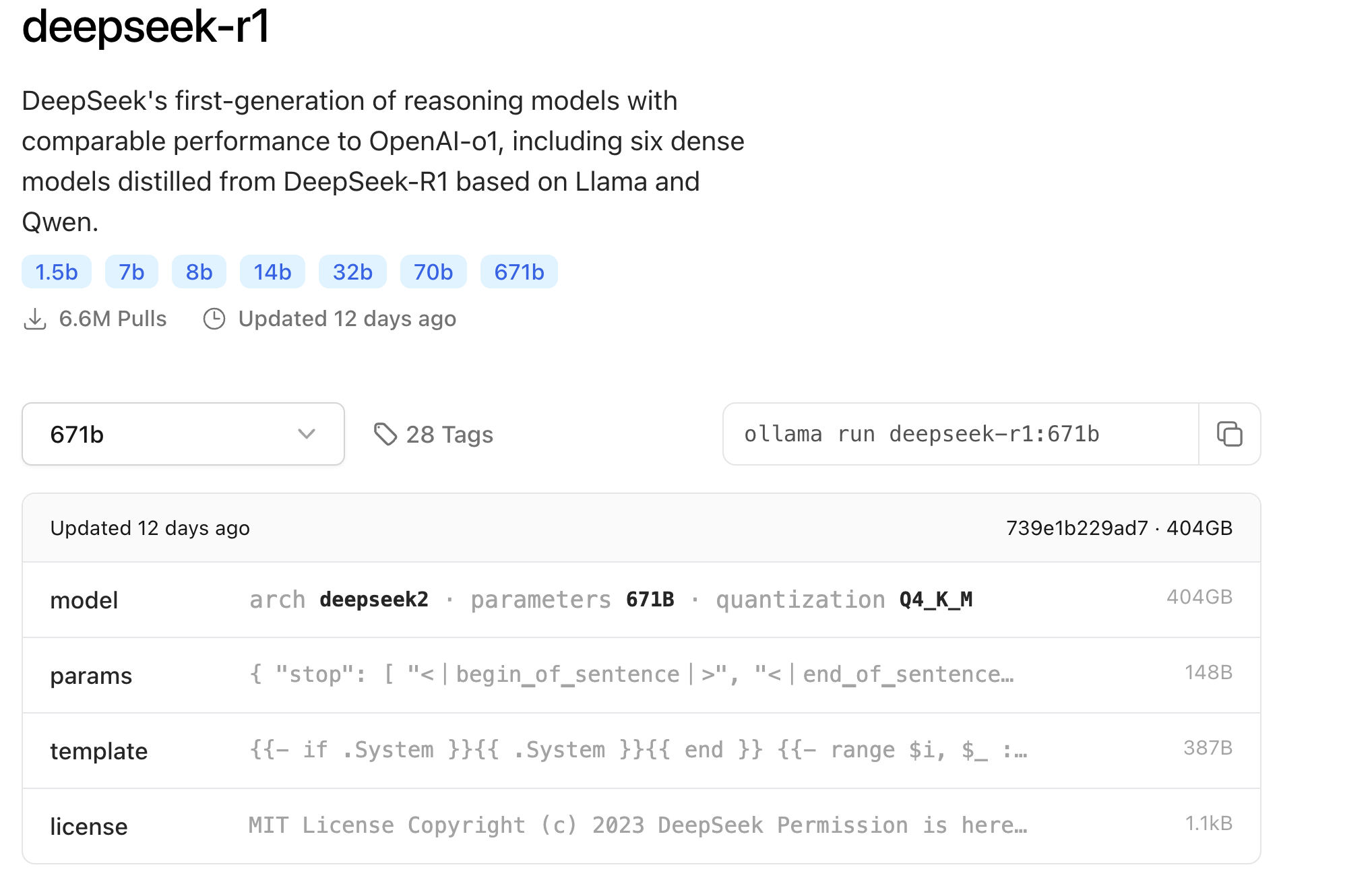

Ollama

使用Ollama进行R1系列模型的本地部署是比较简单的方法,只需下载Ollama程序即可,但是模型均进行了量化。支持官方蒸馏的6款模型和原始671B的R1模型。所有模型均使用4-bit进行量化,最少仅需要1.1G的显存,推荐使用14B模型,需要9G显存,可在消费级显卡上进行部署。

客户端使用

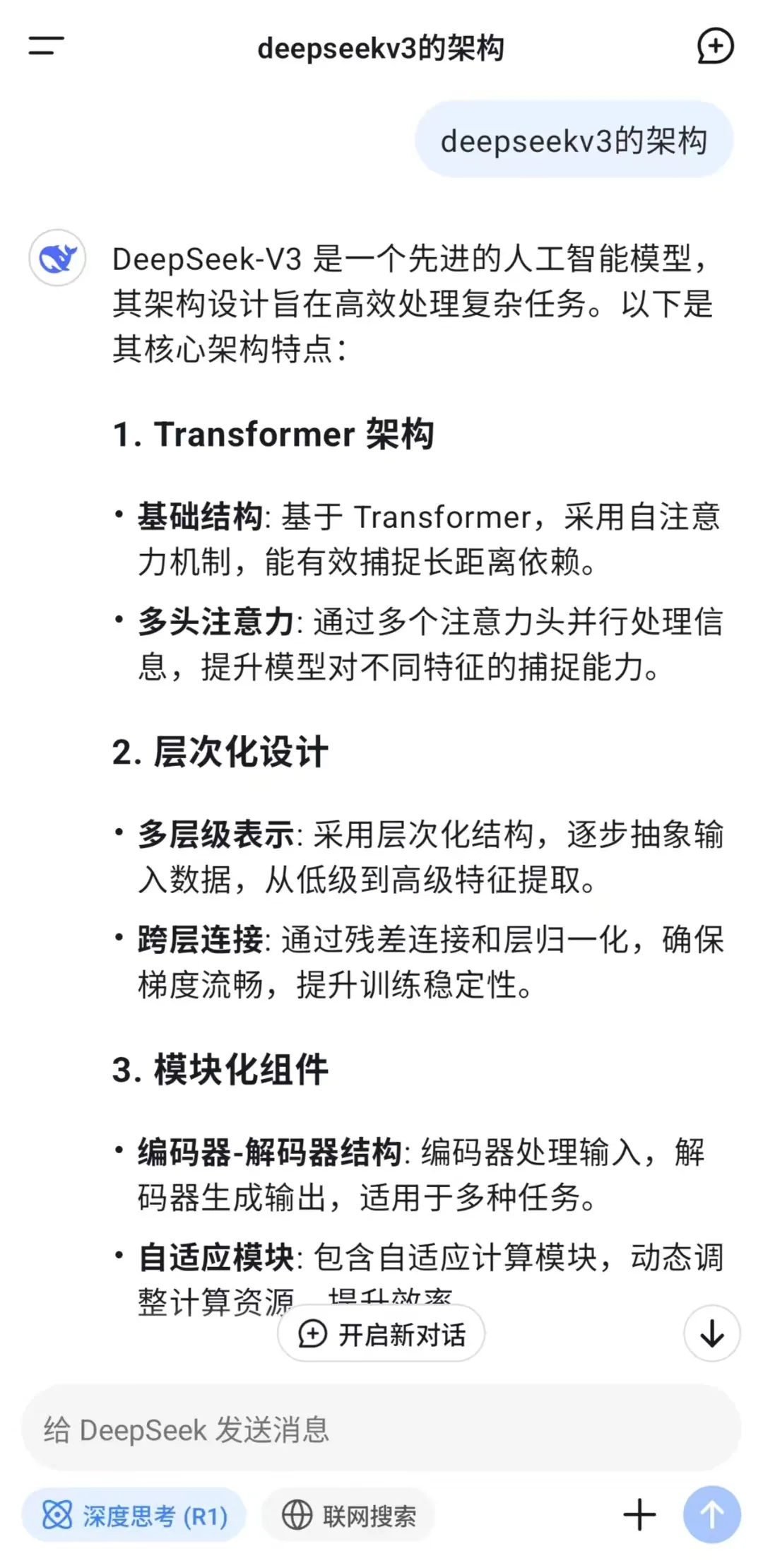

官方支持网页端和手机APP使用DeepSeek系列模型,选择「深度思考(R1)」则会使用R1推理模型,不选择则使用V3对话模型。需要注意目前联网搜索功能暂不可用。

网页端

手机APP

应用商店搜索「DeepSeek」即可下载,安装包仅不到10M,比起其他动辄几十、几百M的智能助手显得太过格格不入了。

API

官方API

由于访问量太大以及恶意攻击,目前官方的API服务暂时还没有恢复。

国内API平台

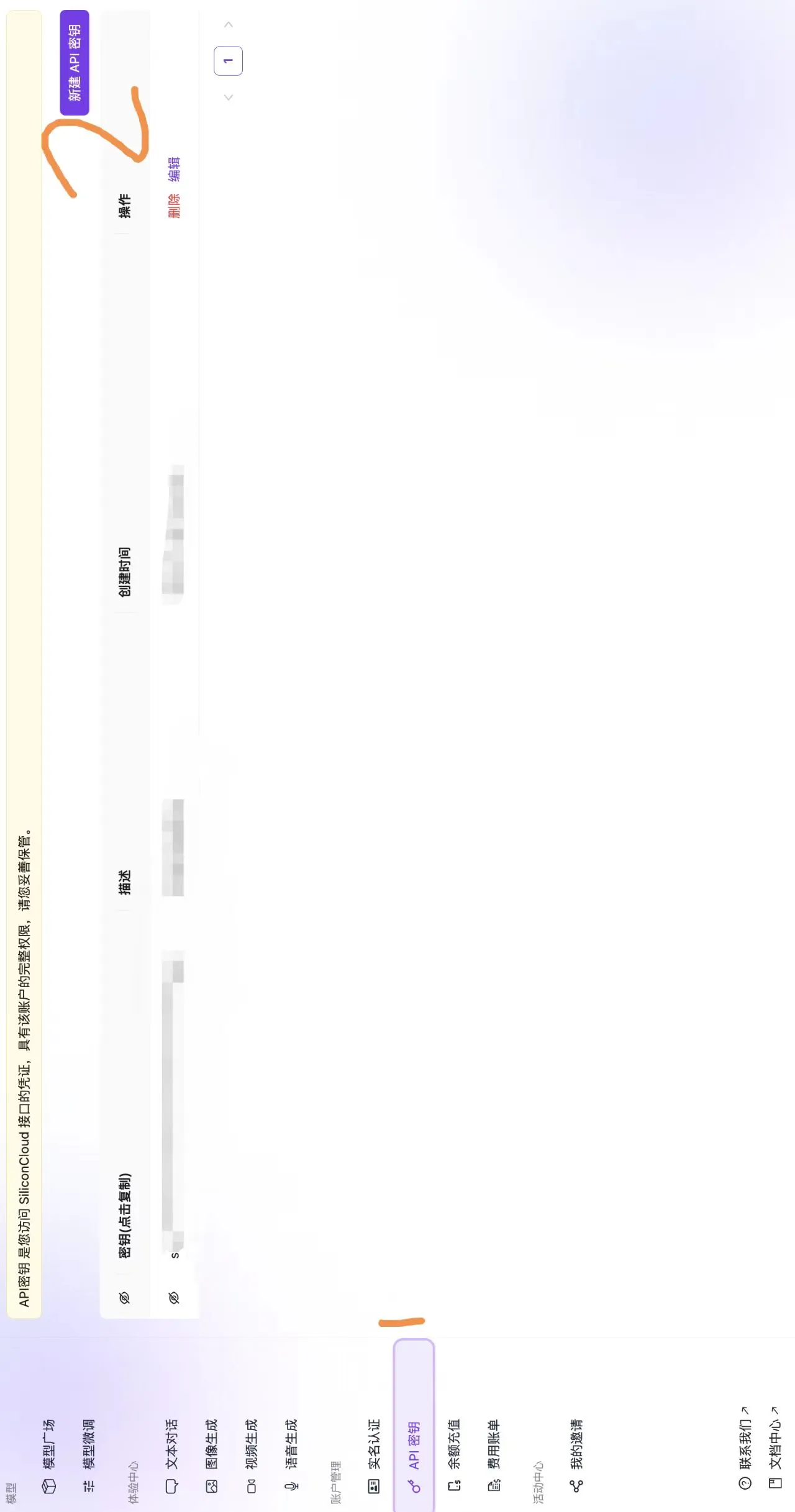

硅基流动联合华为推出了基于910B系列芯片的推理服务,新用户注册即送2000万Tokens(相当于14元额度)。 官网注册地址: https://cloud.siliconflow.cn/i/7M9W6SG1

注册后点击「API密钥」菜单,接着点击「新建API密钥」即可创建API密钥,点击可复制密钥。

第三方客户端

对于编程目的或者软件开发者使用,有Cursor,WindSurf、v0等这些编程助手,而对于一般用户而言,推荐使用ChatBox或者Cherry Studio等这类开源的客户端软件,不需要进行环境设置或者运行程序。

Cherry Studio客户端下载地址:https://cherry-ai.com/

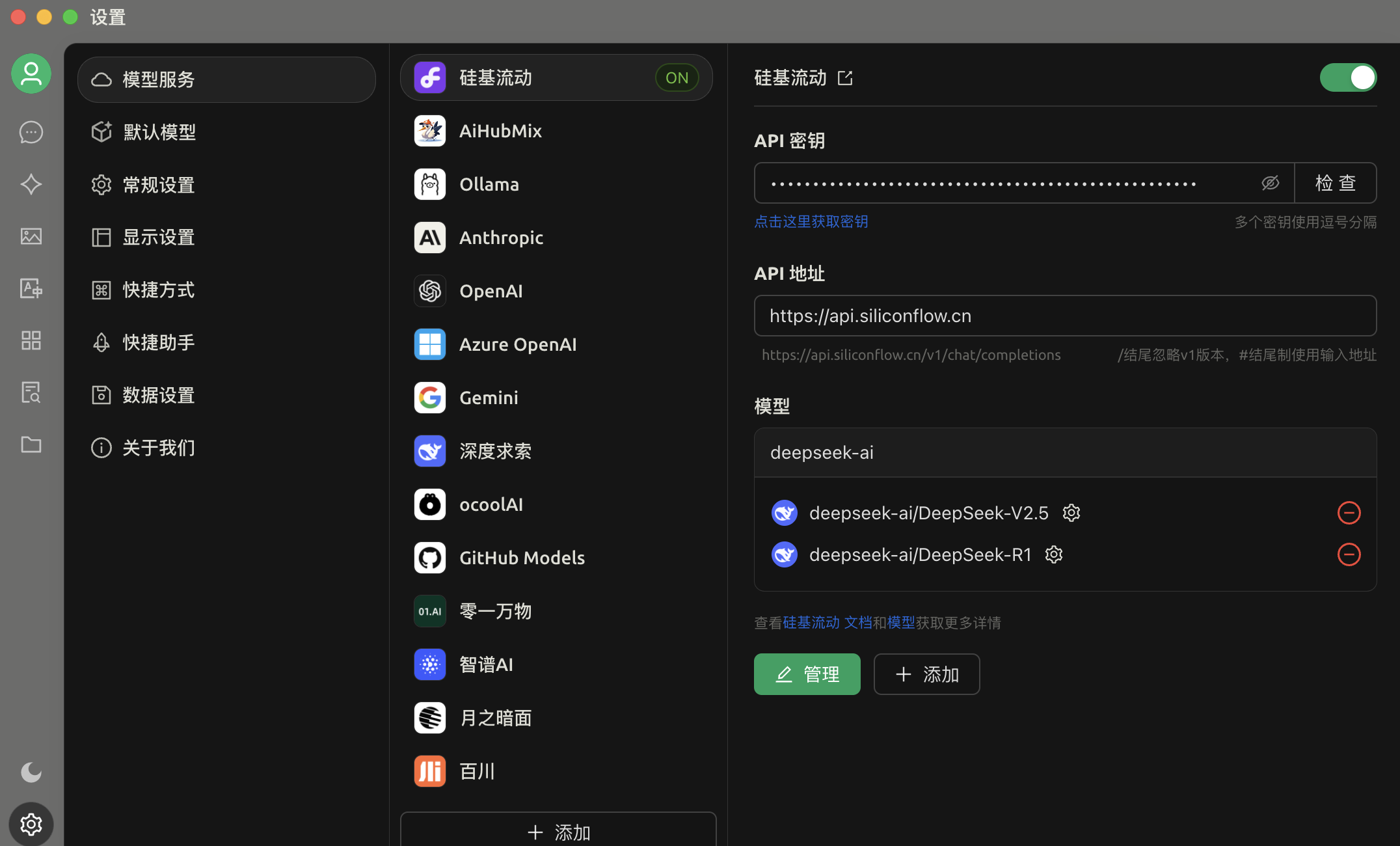

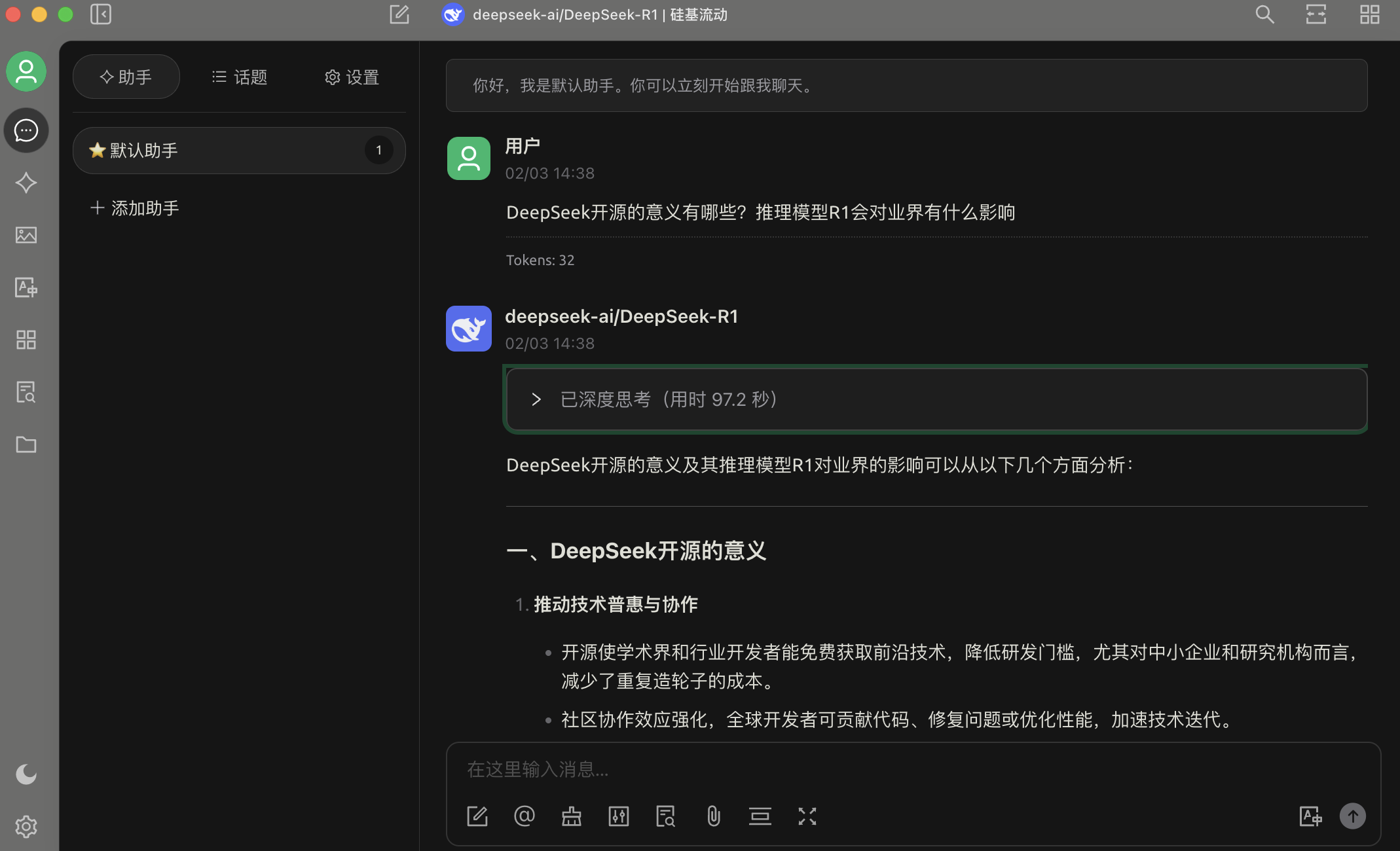

以下以Cherry Studio为例,展示如何接入硅基流动的API,使用R1模型。

选择模型服务商「硅基流动」,填入从硅基流动官网复制的API密钥。

经过实测,一轮简单对话约消耗3000tokens,相当于0.03元的额度。

推荐阅读

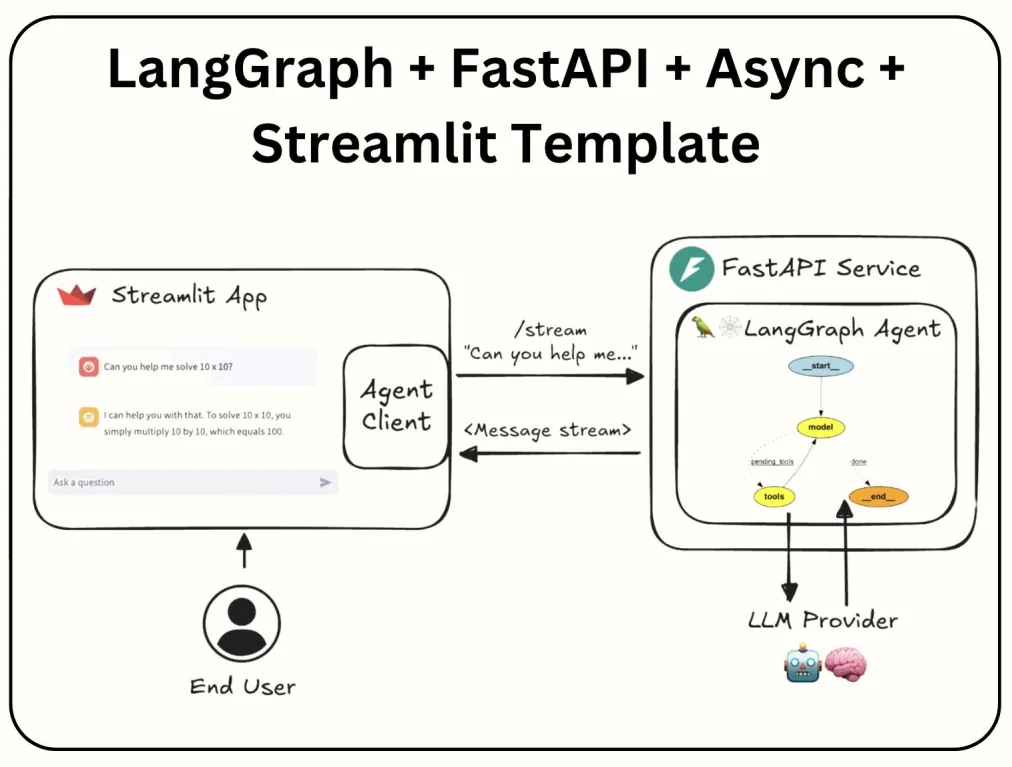

该工具包基于LangGraph、FastAPI和Streamlit构建,提供了构建和运行大模型Agent的最小原子能力,包含LangGraph代理、FastAPI服务、用于与服务交互的客户端以及一个使用客户端提供聊天界面的Streamlit应用。

几天前,通义千问更新了最新的多模态大模型Qwen2.5-VL,拥有包含 3B、7B 和 72B 在内的 3 个模型尺寸,同时完全开源,可在huggingface和modelscope下载到所有模型权重。